Dieser Blog-Beitrag hilft Ihnen zu verstehen, wie Sie das sbteclipse-Plugin installieren und einrichten, um die Scala-Anwendung in Eclipse IDE auszuführen. Lassen Sie uns zunächst verstehen, was SBT ist. Wikipedia definiert es als 'das De-facto-Build-Tool für die Scala-Community, das vom Lift-Webframework und vom Play-Framework verwendet wird'. Es handelt sich im Wesentlichen um ein Open Source-Build-Tool für Scala- und Java-Projekte, ähnlich wie Java Maven oder Ant.

Seine Hauptmerkmale sind:

& bull Native Unterstützung für das Kompilieren von Scala-Code und die Integration in viele Scala-Test-Frameworks

& bull Erstellen Sie Beschreibungen, die in Scala mit DSL geschrieben wurden

& bull Abhängigkeitsmanagement mit Ivy (das Repositorys im Maven-Format unterstützt)

& bull Kontinuierliche Kompilierung, Prüfung und Bereitstellung

& bull Integration mit dem Scala-Interpreter für schnelle Iteration und Debugging

& bull Unterstützung für gemischte Java / Scala-Projekte

Sbteclipse ist jedoch ein Plugin für sbt 0.13. Um dieses Plugin einzurichten, sollte sbt zuerst auf dem System installiert sein.

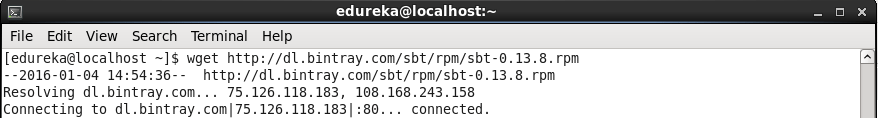

Lassen Sie uns zuerst sbt herunterladen.

Befehl: wget http://dl.bintray.com/sbt/rpm/sbt-0.13.8.rpm

So erstellen Sie ein Objektarray in Java

Befehl: sudo yum localinstall sbt-0.13.8.rpm

Befehl: wget http://dl.bintray.com/sbt/rpm/sbt-0.13.8.rpm

Überprüfen wir nun die sbt-Version.

Befehl: sbt –version

Um Ihr Projekt in Eclipse zu importieren, müssen Sie Ihrer Plugin-Definitionsdatei sbteclipse hinzufügen. Sie können entweder die globale unter ~ / .sbt / plugins / plugins.sbt oder die projektspezifische unter PROJECT_DIR / project / plugins.sbt verwenden:

Fügen wir das Plugin global hinzu, damit wir es nicht in jedem Projekt einzeln hinzufügen müssen. Die Schritte hierfür sind:

Erstellen Sie ein Plugin-Verzeichnis in .sbt / 0.13 /

Befehl: mkdir -p .sbt / 0.13 / plugins

Erstellen Sie eine Datei plugins.sbt

Befehl: sudo gedit .sbt / 0.13 / plugins / plugins.sbt

Um das sbteclipse-Plugin hinzuzufügen, fügen Sie diese Einstellung einfach dieser Datei hinzu.

addSbtPlugin ('com.typesafe.sbteclipse'% 'sbteclipse-plugin'% '4.0.0')

Jetzt ist das sbteclipse Plugin gesetzt.

Sobald die Installation abgeschlossen ist, können wir den zusätzlichen Befehl eclipse verwenden, wenn wir sbt starten.

Dies sind die Schritte, um ein Projekt direkt von sbt auszuführen. Als nächstes lernen wir, wie das Projekt in Eclipse ausgeführt wird.

sbt-Paket

mkdir helloworld

cd helloworld /

mkdir -p src / main / scala

sudo gedit src / main / scala / hello.scala

Geben Sie diesen Code ein:

Objekt Hallo {

def main (args: Array [String]) = {

println ('Hallo Welt')

}}

}}

Erstellen Sie eine build.sbt-Datei im Verzeichnis helloworld.

sudo gedit build.sbt

Unten finden Sie eine sehr einfache sbt-Datei, in der Sie die für Ihre Anwendung erforderlichen Abhängigkeiten hinzufügen können.

sbt-Paket

Dadurch wird die JAR-Datei zum Ausführen dieser Anwendung erstellt. Führen Sie nun diesen Befehl aus, um Ihre Anwendung auszuführen.

Befehl: spark-submit –class “Hello” –master local [2] target / scala-2.10 / hello-world_2.10-1.0.jar

wie man verschachtelte Tabellen in HTML macht

Sbt Eclipse

Mit dem folgenden Befehl wird die Projektfinsternis kompatibel, und Sie können dieses Projekt in Eclipse importieren und erfolgreich ausführen.

Befehl: sbt eclipse

Gehen Sie zu Scala IDE, Datei -> Importieren

Wählen Sie das Stammverzeichnis helloworld.

Sie können jetzt sehen, dass Sie dieses Projekt importieren können, indem Sie auf Fertig stellen klicken.

Adapterklasse in Java mit Beispiel

Lassen Sie es uns jetzt als Scala-Anwendung ausführen.

Nur zu Ihrer Information, wenn Sie SparkConf einstellen, denken Sie immer daran, Master wie folgt einzustellen.

Jetzt können Sie Ihre Anwendung ausführen.

Hast du eine Frage an uns? Bitte erwähnen Sie es in den Kommentaren und wir werden uns bei Ihnen melden.

Zusammenhängende Posts:

Apache Spark gegen Hadoop MapReduce